Opera 正在将对 150 种本地 LLM(大型语言模型)变体的支持集成到 Opera One(该公司的 AI 集成浏览器)的开发人员流中。添加对 AI 的实验性本地支持是浏览器的第一次,并允许直接从浏览器本身轻松访问 AI 模型。

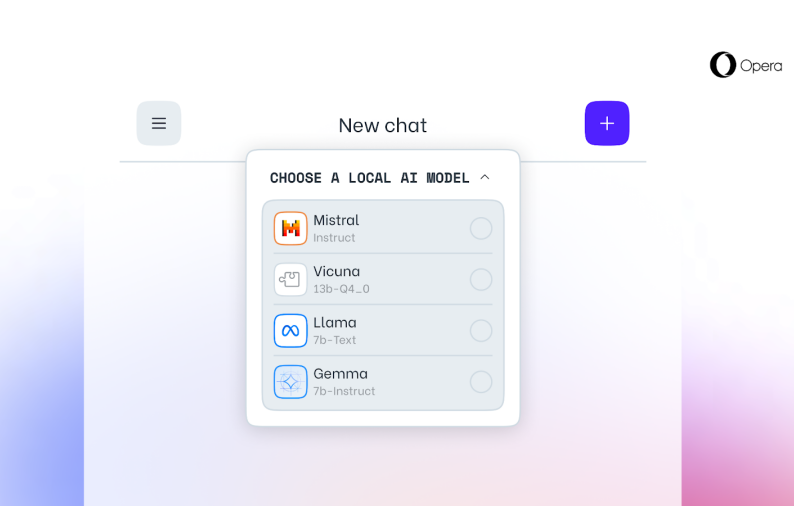

Opera One 中一些比较突出的本地 LLM 包括 Meta 的 Llama、Google 的 Gemma、Vicuna 和 Mistral AI 的 Mistral 等。这些是 Opera 自己的 Aria 聊天机器人的补充。

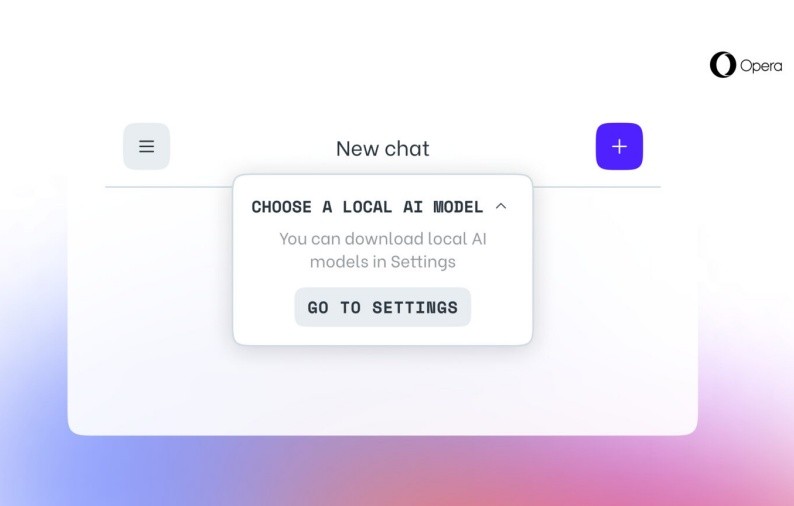

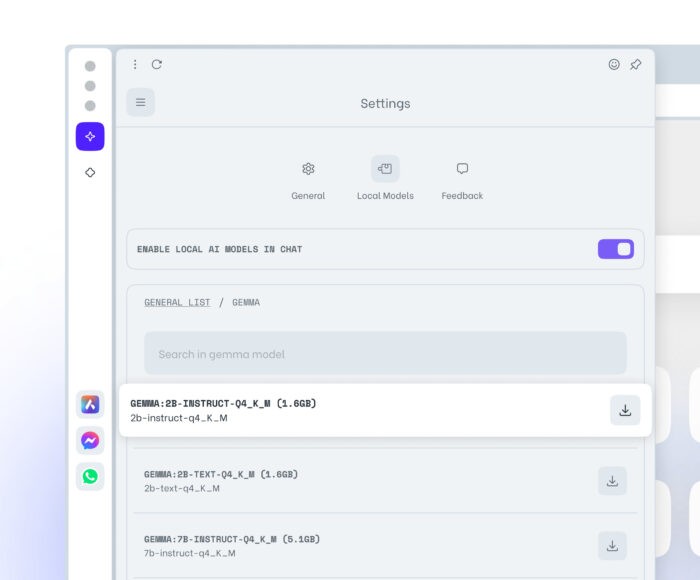

Opera One Developer 用户可以先更新到最新的浏览器版本,然后选择他们想要测试的模型,激活新功能,然后将本地 LLM 下载到他们的机器上。典型的 LLM 需要 2 到 10 GB 的存储空间。下载后,您将能够切换到并使用本地 LLM 而不是 Aria。请参阅我们的指南 如何在 Opera One Developer 上启用和使用本地 AI 模型以了解更多信息。

本地 LLM 有几个好处,例如更好的隐私和安全性,因为数据不会离开您的计算机、离线使用以及整体上增强的浏览器体验。本地 LLM 可能存在的一个缺点是,与基于服务器的 LLM 相比,它在提供输出方面可能很慢,因为处理完全依赖于计算机的硬件功能。因此,即使它适用于大多数现代机器,但较旧的设备可能会感到资源紧张。

尽管如此,将本地 AI 模型集成到浏览器本身是 Opera 向前迈出的一大步,我们可能会看到这成为其他主要浏览器的趋势。

33台词网

33台词网